LLMOの効果測定とは?追うべき5つのKPI・GA4での計測方法・改善の進め方を解説

この記事でわかること

- LLMOの効果測定で追うべき5つのKPIと優先順位

- GA4・Search Console・Ahrefsで測れること/測れないことの違い

- そのまま使える測定シート・固定プロンプトのテンプレート

- 測定データを改善施策につなげる分析と運用サイクルの回し方

LLMOに取り組み始めたものの、「施策の効果をどう測ればいいのかわからない」と感じている方は多いのではないでしょうか。SEOであれば検索順位という明快な指標がありますが、生成AIには同様の仕組みがなく、従来の方法論がそのまま通用しません。

本記事では、LLMOの効果測定で追うべき5つのKPIとその算出方法、GA4・Search Console・Ahrefsといった主要ツールで「何が測れて何が測れないか」の正確な整理、そして測定データを改善施策に結びつけるための分析の進め方までを、アドカルの実務知見を交えて体系的に解説します。そのまま使える測定シートのサンプルや、手動チェック用の固定プロンプト例も掲載していますので、読後すぐに自社の効果測定を始められる構成になっています。

LLMO対策の基本については『LLMOとは何か?AI検索時代の対策方法やSEOとの違いを分かりやすく解説』の記事をご覧ください。

【SEO・LLMO対策でお困りではないですか?】

株式会社アドカルはSEO対策・LLMO対策に強みを持った企業です。

貴社のパートナーとして、少数精鋭で担当させていただくので、

「LLMO対策について詳しく知りたい」

「現状のSEO対策で成果が出ていない」

「LLMO対策でAI検索からの集客を強化したい」

とお悩みの方は、ぜひ弊社にご相談ください。

貴社のご相談内容に合わせて、最適なご提案をさせていただきます。

サービスの詳細は下記からご確認ください。無料相談も可能です。

目次

LLMO効果測定でまず見るべき3つの指標

LLMOの効果測定に取り組む際、「結局何を見ればいいのか」を最初に押さえておきましょう。以下では、優先度の高い指標から順に全体像を示します。

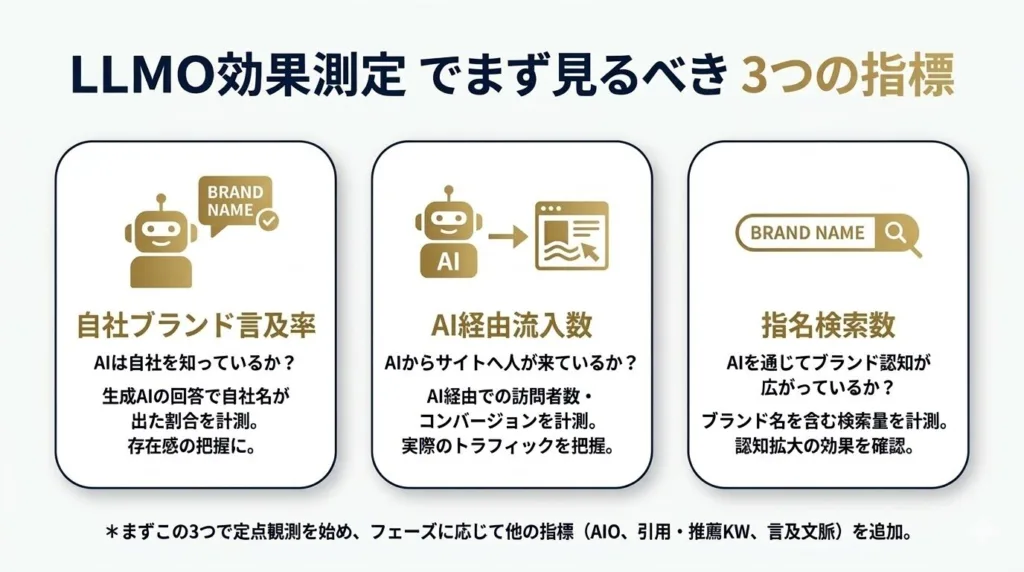

最初はこの3つだけ追えばよい

LLMOの効果測定で追うべきKPIは全部で5つありますが、すべてを一度に始める必要はありません。まず最優先で追うべきは、「自社ブランド言及率」「AI経由流入数」「指名検索数」の3つです。この3つを押さえるだけで、生成AIにおける自社の存在感の変化をおおまかに把握できます。自社ブランド言及率は「生成AIが自社を知っているか」、AI経由流入数は「AIから実際にサイトへ人が来ているか」、指名検索数は「AIを通じてブランド認知が広がっているか」をそれぞれ捉える指標です。

フェーズに応じて追加するKPI

基本の3指標で定点観測を始めたら、施策の成熟度に応じてKPIを追加していきます。施策の立ち上げ期は上記の3指標に集中し、改善期に入ったら「AI Overviews・生成AIでの引用・推薦キーワード数」を追加して、どのキーワードで評価されているかを把握します。さらに成果を拡大するフェーズでは、「言及内容の文脈とエンティティ認識の正確性」を加え、AIが自社をどのような文脈で紹介しているかの質的評価まで行います。このように段階的にKPIを増やすことで、測定の負荷を抑えながら精度を上げていけます。

▼参考記事

AI Overviewとは?サイト流入を増やす5つの実践的SEO対策

5つのKPIの全体像

本記事で解説する5つのKPIの全体像を以下の表にまとめます。各KPIの詳細な定義・算出方法・改善基準は後述のセクションで解説しますので、まずは全体の見取り図として把握してください。

| KPI | 定義 | 算出方法 | 主なツール | 評価の目安 |

|---|---|---|---|---|

| 自社ブランド言及率 | AI回答で自社名が出た割合 | 自社言及回数÷実行回数×100 | Ahrefs Brand Radar/手動 | 主要プロンプトで継続監視 |

| 引用・推薦KW数 | AIO・生成AIで自社が出るKW総数 | SEOツール抽出+手動確認の合算 | Ahrefs/Semrush | 事業上重要なKWでの有無を重視 |

| AI経由流入数・CV | AIドメインからの訪問・CV | GA4の参照元フィルタで抽出 | GA4 | 月次推移+CVRの変化を確認 |

| 指名検索数 | ブランド名を含む検索量 | GSCの指名クエリ表示回数・クリック数 | Google Search Console | 3か月単位で増減を評価 |

| 言及文脈・エンティティ正確性 | AIが自社をどう紹介しているか | 回答の文脈分類+情報正誤の確認 | 手動チェック | 月次で定性記録・推移を追跡 |

LLMOの効果測定が難しい理由とSEOとの違い

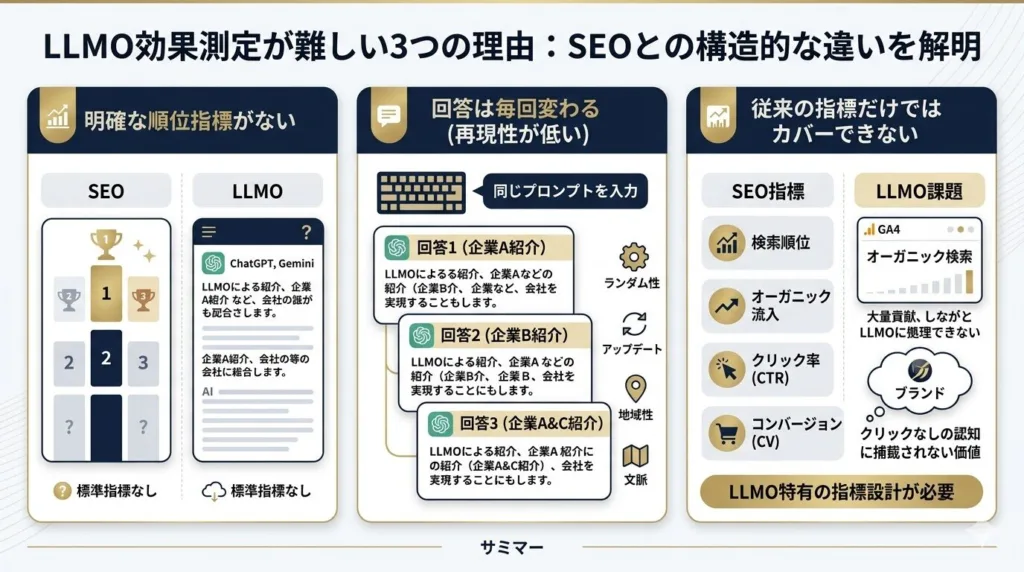

「何を見ればいいかはわかった。でもなぜ難しいのか?」――ここでは、LLMOの効果測定が従来のSEOと異なる3つの構造的な理由を整理します。

明確な順位指標がないため成果が見えにくい

SEOでは「狙ったキーワードで検索順位が何位か」という明確な数値があり、施策の効果を判断しやすい構造になっています。一方、LLMOでは生成AIの回答内に自社が言及されるかどうかが成果の中心となりますが、そこには「1位」「2位」のような順位の概念がありません。ChatGPTやGeminiの回答に自社名が登場しても、それが何社中何番目に紹介されたのか、どの程度の評価で推薦されたのかを定量化する標準的な指標は現時点で存在しません。そのため、「成果が出ているのかどうか判断できない」という状況に陥りやすいのです。

生成AIの回答は毎回変わるため再現性が低い

生成AIの回答は、同じプロンプトを入力しても毎回異なる結果が返されることがあります。その要因は一つではなく、モデルの出力に含まれるランダム性(温度パラメータと呼ばれる仕組み)に加え、モデル自体のアップデート、参照する情報源のインデックス更新、ユーザーの地域やアカウント設定による差異、直前の会話文脈の影響など、複数の要素が絡み合っています。ある日は自社が推薦されていたのに、翌日に同じ質問をすると別の企業が紹介されるというケースは珍しくありません。1回の確認だけでは信頼できるデータにならないため、同一プロンプトを複数回・複数日にわたって実行し、統計的に傾向を把握するアプローチが求められます。

従来のSEO指標だけではカバーできない

SEOの効果測定では、検索順位・オーガニック流入数・クリック率(CTR)・コンバージョン数といった確立された指標体系があります。しかし、LLMOの成果はこれらの指標だけでは十分に捉えられません。たとえば、生成AIの回答内で自社が推薦されることで指名検索が増えた場合でも、GA4上では「オーガニック検索」として計測され、生成AIの貢献が見えにくくなります。また、AIの回答を見たユーザーがクリックせずにブランドを認知するケースも多く、従来の流入ベースの指標では価値を測りきれません。LLMOの効果測定には、SEO指標に加えてAI特有の指標を新たに設計する必要があるのです。

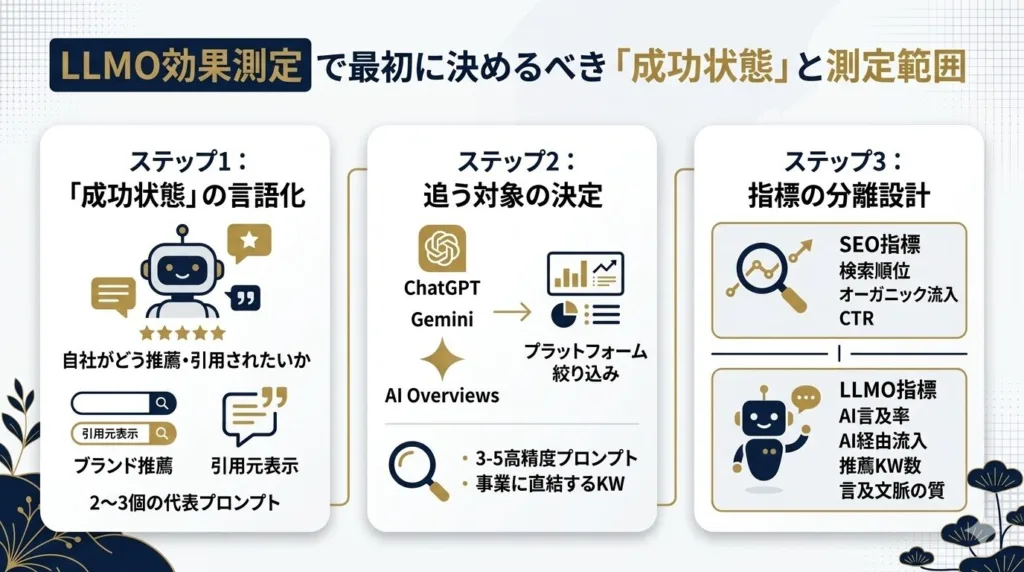

LLMOの効果測定で最初に決めるべき「成功状態」と測定範囲

効果測定を始める前に、自社にとっての「成功とは何か」を定義し、測定の範囲を決めることが重要です。ここでは、測定設計の3つのステップを解説します。

自社がAIにどう推薦されたいかを定義する

LLMOの効果測定で最初に行うべきは、「自社が生成AIからどのように扱われている状態を成功とするか」を社内で明確にすることです。たとえば、「『○○ おすすめ企業』というプロンプトに対して、ChatGPTとGeminiの両方で自社名が推薦される状態」や「AI Overviewsで自社の記事が引用元として表示される状態」のように、具体的な場面を想定して定義します。この定義が曖昧なままだと、データを集めても「結局うまくいっているのか」が判断できません。まずは2〜3個の代表的なプロンプトやキーワードに絞って、目指すべき推薦・引用の姿を言語化しましょう。

追うAIプラットフォームと対象キーワードを決める

生成AIのプラットフォームはChatGPT、Gemini、Perplexity、Claude、Google AI Overviews、AIモードなど多岐にわたります。すべてを網羅的に追跡するのは現実的ではないため、自社のターゲットユーザーが利用する可能性の高いプラットフォームに絞ることが大切です。アドカルでの実務を踏まえると、まずChatGPT・Gemini・AI Overviewsの3つを基本の定点観測対象とすることを推奨しています。

利用シェアが大きく、かつ回答の傾向が異なるため、3つを押さえるだけでも全体像をつかみやすくなります。AIモードについては、対象市場での表示状況や自社への影響度を見ながら追加を検討するとよいでしょう。対象キーワードは、自社の事業に直結する「比較・検討系」「おすすめ系」のプロンプトを3〜5個選定し、継続的に追跡できる範囲に絞ります。

SEO指標とLLMO指標を分けて設計する

効果測定の設計段階で重要なのは、SEOの指標とLLMO固有の指標を明確に分けて管理することです。SEO指標としては検索順位・オーガニック流入数・CTRなどがあり、LLMO指標としてはAI言及率・AI経由流入数・推薦キーワード数・言及文脈の質などが挙げられます。この2つを混在させると、「流入が増えたのはSEO施策のおかげなのか、LLMO施策の成果なのか」が判別できなくなります。レポートのフォーマットも、SEOとLLMOで別シートまたは別セクションに分けて設計しておくと、施策ごとの効果を正確に評価でき、改善の方向性も明確になります。

LLMOの効果測定で追うべき5つのKPI

ここでは、LLMOの成果を多角的に捉えるために追うべき5つのKPIを詳しく解説します。各KPIについて「定義」「算出方法」「使用ツール」「改善判断の基準」の4点を整理しています。

自社ブランド言及率

自社ブランド言及率とは、特定のプロンプトに対する生成AIの回答において、自社のブランド名・サービス名が言及された割合を示す指標です。

算出方法としては、対象プロンプトを各AIプラットフォームで複数回(目安として月30回以上)実行し、「自社が言及された回数÷総実行回数×100」で算出します。使用ツールは、Ahrefs Brand Radarのカスタムクエリ機能が有効です。手動で行う場合は、ChatGPT・Gemini・Perplexityなどに直接プロンプトを入力して記録します。改善判断の基準としては、主要プロンプトでの言及率が50%を下回る場合や、前月比で10ポイント以上低下した場合は、コンテンツの見直しやE-E-A-T強化などの改善対象と判断します。

AI Overviews・AIモード・生成AIでの引用・推薦キーワード数

この指標は、Google AI OverviewsやAIモード、ChatGPT・Geminiなどの生成AIにおいて、自社が引用・推薦されているキーワードの総数を指します。算出方法は、SEOツールを使って自社ドメインがAI Overviewsに引用されているキーワードを抽出し、それに加えて手動で確認した生成AI上の推薦キーワードを合算します。使用ツールとしては、AhrefsのサイトエクスプローラーやBrand Radar、Semrushのオーガニック検索分析機能が挙げられます。改善判断の基準は、自社の事業に重要な「比較・検討系」「おすすめ系」のキーワードで引用・推薦が確認できない場合に優先的に対策します。キーワード数の絶対値よりも、事業貢献度の高いキーワードでの有無を重視しましょう。

AI経由流入数・コンバージョン数・コンバージョン率

生成AIから自社サイトに流入したセッション数、そこから発生したコンバージョン数、およびコンバージョン率を測定する指標です。GA4で「セッションの参照元」を確認し、chatgpt.com、perplexity.ai、gemini.google.com、claude.ai、copilot.microsoft.comなどのドメインからの流入を抽出します。改善判断の基準は、AI経由の流入数が月間で一定数あるにもかかわらずコンバージョンが発生していない場合、ランディングページの内容や導線を見直す必要があります。また、流入数自体が少なくてもコンバージョン率が高い傾向があるため、率の推移にも注目しましょう。

指名検索数の増減

指名検索数とは、Google検索において自社名・サービス名・ブランド名を含む検索クエリの表示回数やクリック数を指します。Google Search Consoleの「検索パフォーマンス」レポートでブランド名を含むクエリをフィルタし、月次の表示回数・クリック数の推移を追跡します。生成AIで自社が推薦された結果、ユーザーがGoogleで指名検索を行うケースが増えるため、LLMOの間接的な成果指標として重要です。改善判断の基準としては、LLMO施策を開始した時点をベースラインとし、3か月ごとに指名検索数の増減を評価します。季節変動を除外した上で、ベースラインから増加傾向が見られなければ、AI上でのブランド露出施策を強化する必要があります。

言及内容の文脈とエンティティ認識の正確性

この指標は、生成AIが自社をどのような文脈で言及しているかという定性的な評価と、自社のエンティティ情報(事業内容・所在地・サービス内容など)が正しく認識されているかの確認をセットで行うものです。まず文脈の評価として、AIの回答における自社の言及が「推薦」「比較候補としての中立紹介」「否定的な言及」「誤認に基づく言及」のいずれに分類されるかを記録します。たとえば、「おすすめの○○企業」というプロンプトで自社が「推薦」として紹介されているのか、単に「一覧の中で名前が出ている」だけなのかで、施策の方向性は大きく変わります。

エンティティ認識の正確性については、ChatGPTやGeminiに「○○(自社名)とはどんな会社ですか?」と質問し、回答に含まれる事業内容・提供サービス・所在地・代表者名などの情報が正確かを確認します。誤った情報が返される場合は、自社サイトや外部メディアにおける情報の整合性を見直す必要があります。構造化データの整備、公式サイトでの明確な情報記載、外部メディアでの一貫した情報発信がエンティティ認識の改善に有効です。この定性評価は、月次の定点観測で記録し、文脈の変化やエンティティ情報の修正状況を追跡します。

▼参考記事

エンティティとは?LLMOで欠かせない基礎知識と今すぐ始める4つの最適化戦略

GA4・Search Console・Ahrefsで何が測れて何が測れないか

LLMOの効果測定では、「このツールで何が見えて、何が見えないのか」を正確に理解しておくことが重要です。ここでは主要3ツールの計測範囲と限界を整理します。

GA4で測れること・測れないこと

GA4では、ChatGPT(chatgpt.com)やPerplexity(perplexity.ai)、Gemini(gemini.google.com)など、独自ドメインを持つ外部AIサービスからの参照元流入は確認できます。参照元ドメインで絞り込むことで、AI経由の流入数やコンバージョンを把握可能です。一方で、AI OverviewsやAIモード経由のクリックは参照元がgoogle.comのままであるため、通常のオーガニック検索(google/organic)に含まれ分離できません。また、ChatGPTなどのモバイルアプリ経由の流入は参照元情報が欠落し、(direct)/(none)として計測されるケースもあります。GA4で見えるAI流入は全体の一部であるという前提で分析を進める必要があります。具体的な操作手順や正規表現の設定方法は、次章「計測手順」で詳しく解説します。

Search Consoleで測れること・測れないこと

Google Search Consoleの検索パフォーマンスレポートでは、AI OverviewsやAIモード内のリンクのクリック数・表示回数・掲載順位が計測対象に含まれています。これはGoogleが公式ヘルプで明示しています。AI Overviews内に自社のリンクが表示された場合は表示回数としてカウントされ、そのリンクがクリックされればクリック数に反映されます。掲載順位についてはAI Overviews内のリンクすべてに同一の順位(検索結果内での位置)が付与されます。

ただし、Search Consoleには「AI Overview専用のレポート」は存在しません。AI Overviewからのデータは通常のウェブ検索データと統合されて表示されるため、「このクリックがAI Overview経由なのか、通常の青リンク経由なのか」を切り分けることはできません。そのため、Search ConsoleはLLMOの効果を直接測るツールというよりも、指名検索数の追跡やGoogle検索全体での表示状況を把握するためのツールとして位置づけるのが適切です。Search Consoleを使った指名検索の具体的な追跡手順は、次章で解説します。

Ahrefs Brand Radarで測れること・測れないこと

Ahrefs Brand Radar(ブランドレーダー)は、ChatGPT・Gemini・Perplexity・Copilot・AI Overviews・AIモードの6つのAIプラットフォームにおけるブランド言及状況を追跡できるツールです。1億5,000万件以上のプロンプトデータに基づいて、自社ブランドがどのプロンプトで言及されているか、競合との比較でどのようなポジションにあるかを可視化できます。「カスタムクエリ」機能を使えば、自社にとって重要なプロンプトを独自に設定し、ChatGPT・Gemini・Perplexity・Copilotの各プラットフォームで追跡頻度(毎日・毎週・毎月)を選んで継続監視が可能です。

一方で、Brand Radarで見えるのはAhrefsが独自に収集したプロンプトへの回答データであり、実際のユーザーの検索行動やサイトへの流入データではありません。「言及されている」ことと「流入が発生している」ことは別の話なので、Brand Radarのデータはあくまで露出状況の把握に使い、流入やCVはGA4で別途追跡するという使い分けが重要です。また、有料プランが前提となるため(AI Overviewsプランの場合、年額で一定のコストがかかります)、まずは無料の手動チェックから始めて必要に応じて導入を検討するのがよいでしょう。

LLMOの効果測定に使えるツールと具体的な計測手順

ここでは、前章で整理したツールの計測範囲を踏まえて、実際の計測手順とすぐ使えるコピペ要素を紹介します。

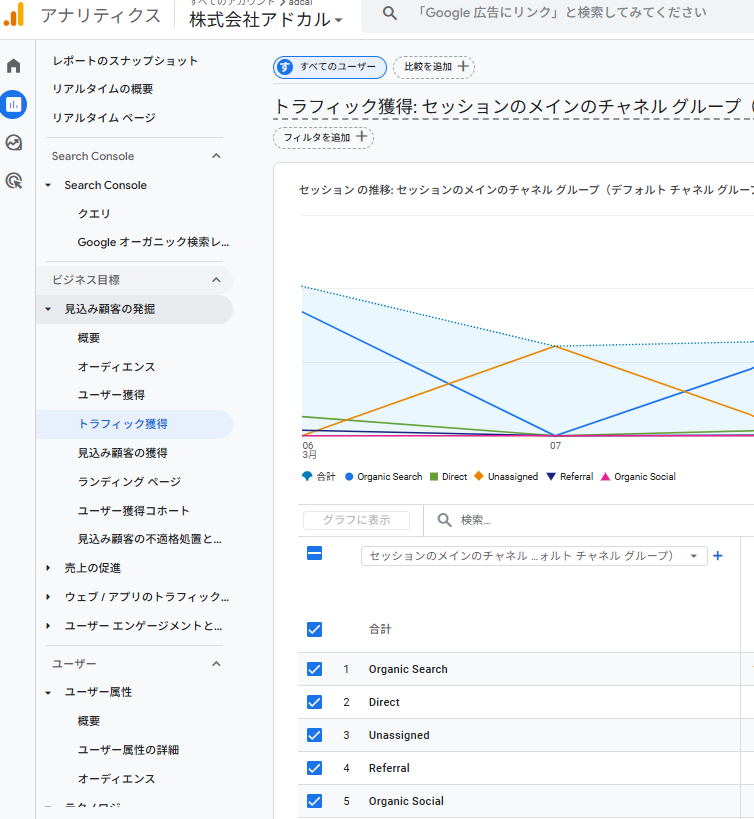

GA4でAI流入・コンバージョンを計測する手順

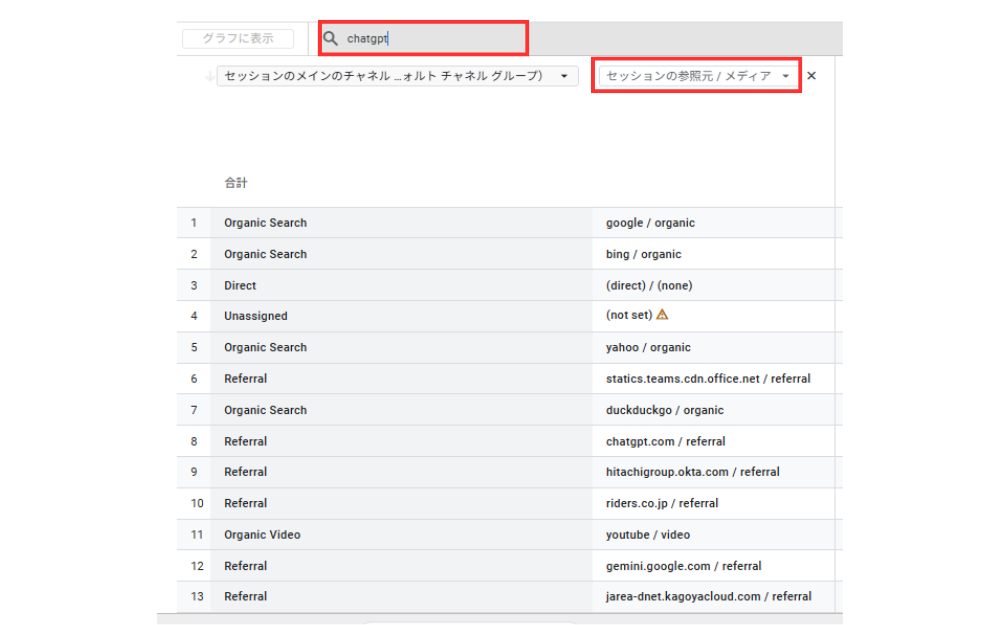

GA4でAI経由の流入を確認する基本的な手順は、まず「レポート」→「集客」→「トラフィック獲得」を開きます。

セカンダリディメンションで「セッションの参照元/メディア」を表示します。次に、画面上部の検索バーにchatgptやperplexityなどのAIサービス名を入力して絞り込みます。

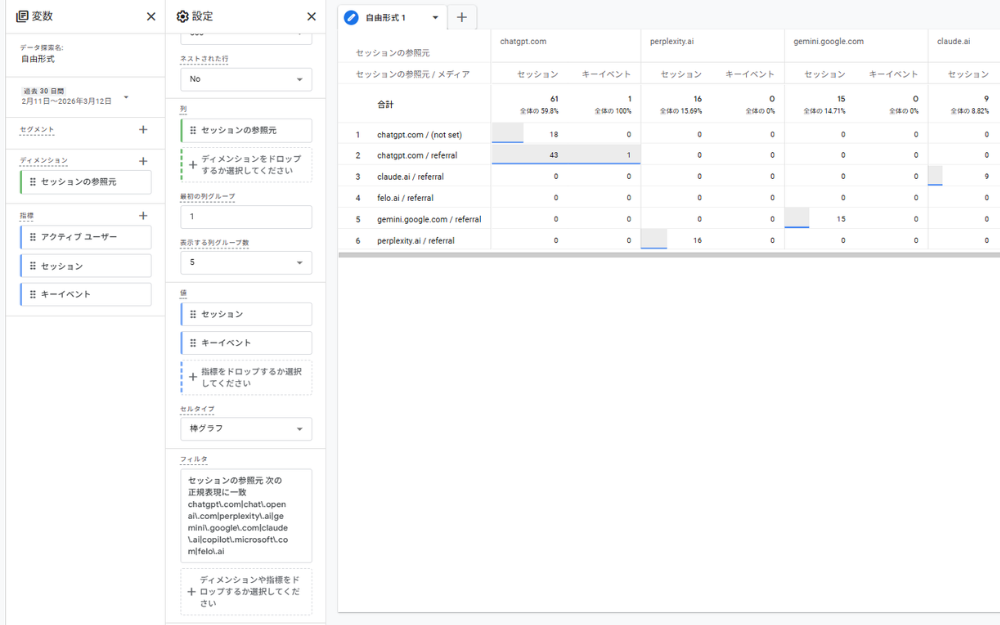

より詳細に分析したい場合は、「探索」の「自由形式」レポートを使います。

ディメンションに「セッションの参照元」、指標に「セッション」「キーイベント」「セッションのキーイベント率」を設定し、フィルタで以下の正規表現を使って主要AI参照元を一括抽出します。

chatgpt\.com|chat\.openai\.com|perplexity\.ai|gemini\.google\.com|claude\.ai|copilot\.microsoft\.com|felo\.ai

継続的にモニタリングする場合は、GA4のカスタムチャネルグループで「AI」チャネルを作成するか、Looker Studioと連携してAI流入専用のダッシュボードを作成しておくと、月次レポートの効率が大幅に上がります。

Search Consoleで指名検索の増減を追跡する方法

Google Search Consoleの「検索パフォーマンス」レポートで、指名検索の増減を追跡できます。手順としては、「検索パフォーマンス」を開き、「クエリ」タブで自社ブランド名を含むクエリをフィルタします。

フィルタ条件は「クエリ:次を含む:(自社名)」と設定し、期間を比較モードにして前月同期間と並べます。表示回数・クリック数の両方を確認し、LLMO施策開始前をベースラインとして3か月ごとに評価します。指名検索が増加傾向にあれば、生成AI上でのブランド露出が間接的に効果を発揮している可能性が高いと判断できます。

手動チェックを効率化するプロンプト設計と記録表の作り方

有料ツールを導入せずに効果測定を始める場合、手動チェックが基本になります。効率化のポイントは、チェック対象のプロンプトをあらかじめ固定し、記録フォーマットを統一することです。まず、自社が推薦されたいプロンプトを3〜5個選定します。以下のような比較・検討系のプロンプトが効果的です。

<手動チェック用の固定プロンプト例>

・「○○(業種名)のおすすめ企業を教えて」

・「○○(サービス名)を依頼するならどこがいい?」

・「○○(業種名) おすすめ 比較」

・「○○(自社名)とはどんな会社ですか?」(エンティティ確認用)

次に、記録用のスプレッドシートを用意し、「日付」「AI名」「プロンプト」「自社言及有無」「競合言及有無」「引用URL有無」「言及文脈」「メモ」の列を設定します。チェック実行時には、同一プロンプトをChatGPT・Gemini・AI Overviewsの3つで実行し、結果を記録します。アドカルの実務では、チェックの実行時間帯を固定(たとえば毎週月曜の午前10時)することで、回答のばらつきを最小限に抑えつつ、比較可能なデータを蓄積しています。

アドカルの実務で行っているLLMO効果測定の進め方

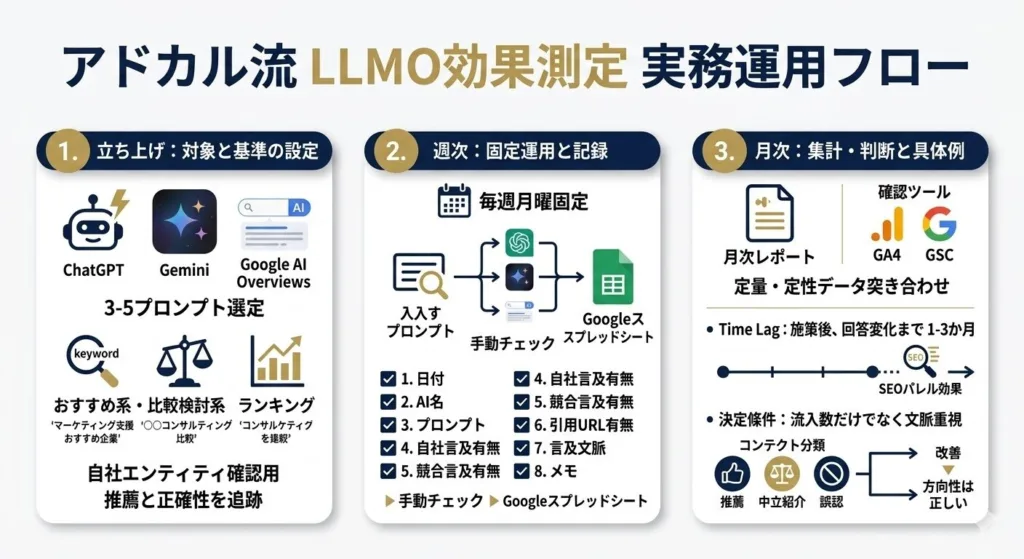

ここでは、アドカルが実際にクライアントのLLMO支援で行っている効果測定の進め方を紹介します。一般論ではなく、実務で試行錯誤してきた中で定着した運用フローです。

最初に追跡したAI・プロンプト・キーワード

アドカルでは、LLMO効果測定の立ち上げ時に、まずChatGPT・Gemini・AI Overviewsの3つのプラットフォームを定点観測の対象としています。追跡対象のプロンプトは、クライアントの事業に直結する「おすすめ系」と「比較・検討系」を中心に3〜5個選定します。たとえば、マーケティング支援の案件であれば「マーケティング支援 おすすめ企業」「○○コンサルティング 比較」「○○を依頼するならどの会社がいい?」といったプロンプトです。加えて、「○○(クライアント名)とはどんな会社ですか?」というエンティティ確認用のプロンプトも必ず含めます。これにより、推薦状況と情報の正確性を同時に追跡できます。

毎週どのように記録し、月次でどう判断しているか

週次の手動チェックは毎週月曜に固定で実施しています。固定プロンプトを3つのAIプラットフォームに入力し、結果をGoogleスプレッドシートの記録表に入力します。記録項目は「日付・AI名・プロンプト・自社言及有無・競合言及有無・引用URL有無・言及文脈・メモ」の8項目です。月末には、この週次データを集計し、言及率の推移・文脈の変化・競合との比較を月次レポートにまとめます。GA4のAI経由流入数とSearch Consoleの指名検索数もこのタイミングで確認し、定量データと定性データを突き合わせて「施策が効いているか」を判断します。

実際に見えた変化と判断の具体例

実務の中で見えてきた傾向として、コンテンツのリライトや各種施策を実施してから、生成AIの回答に変化が現れるまでには1〜3か月程度のタイムラグがあります。一方で、AI Overviewsでの引用はさらに時間がかかる傾向があり、コンテンツの評価がGoogle検索のランキングとも連動しているため、SEO施策と並行して進めることが効果的です。アドカルでは、流入だけでなく言及内容の質(推薦か、中立紹介か、誤認か)も重視しており、数字が動かなくても文脈が改善していれば「方向性は正しい」と判断しています。

アドカルのような外部の専門家に依頼を検討する場合は下記の比較記事も参考にしてみてください。

LLMO対策会社おすすめ14選を比較【2026年最新】選び方や料金相場も解説

LLMOの効果測定を継続するための運用設計

効果測定は一度やって終わりではなく、継続的な定点観測によって意味を持ちます。ここでは、測定を無理なく続けるための運用設計のポイントを解説します。

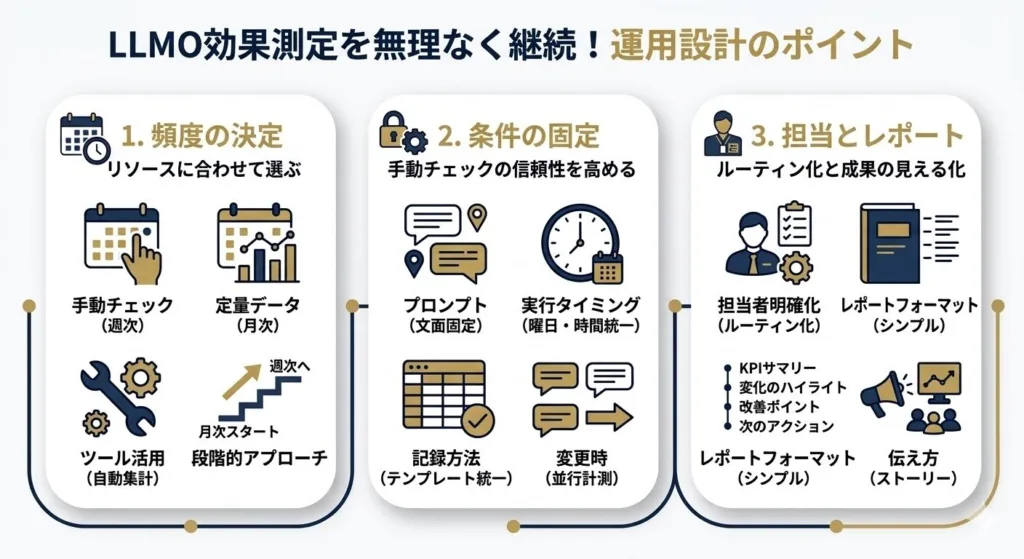

週次・月次のどちらで測定するかを決める

測定頻度は、自社のリソースと施策のスピードに応じて決めます。手動チェックが中心の場合、すべてのKPIを週次で追うのは負荷が高いため、「ブランド言及率」や「言及文脈」の手動チェックは週次、「AI経由流入数」「指名検索数」など定量データの集計は月次で行う、といった使い分けが現実的です。Ahrefs Brand Radarなどのツールを導入している場合は、ツール側で自動集計されるため、月次レポートにまとめて確認する運用でも十分です。まずは月次からスタートし、施策の改善サイクルが回り始めたら週次に切り替えるという段階的なアプローチも有効です。

測定プロンプト・実行時間帯・記録方法を固定する

手動チェックの信頼性を高めるためには、測定条件を可能な限り固定することが重要です。具体的には、チェック対象のプロンプト文面を一字一句固定し、実行する曜日・時間帯も統一します。生成AIの回答はタイミングによって変動するため、条件をそろえることで変動要因を減らし、経時変化を比較しやすくなります。記録方法もGoogleスプレッドシートなど共有可能なツールに統一し、記録者によって粒度がばらつかないようテンプレートを用意しておきましょう。プロンプト文面を途中で変更する場合は、旧プロンプトと新プロンプトを一定期間並行して計測し、データの連続性を確保することが望ましいです。

担当者とレポートフォーマットを決める

効果測定を継続するうえで最も重要なのは、「誰がやるか」を明確にすることです。担当者が決まっていない測定業務は、忙しい時期に真っ先に後回しにされがちです。LLMO効果測定の担当者には、SEO担当やマーケティング担当を任命し、週次・月次のチェックをルーティン業務として組み込みましょう。

月次レポートのフォーマットは、以下の4項目で構成するとシンプルかつ実用的です。

・KPIサマリー:5つのKPIの今月の数値と前月比

・変化のハイライト:特に大きく動いた指標や新たに確認された言及

・改善が必要なポイント:言及率が低下したKWや誤認が確認されたエンティティ情報

・次のアクション:翌月に実行する具体的な施策

経営層やチームへの報告に使う場合は、数値の羅列ではなく、「どのAIプラットフォームで自社の推薦状況がどう変化したか」というストーリーで伝えると、施策への理解と投資判断を得やすくなります。

LLMO対策の内製化については『LLMO対策の内製化の進め方を解説!5つのステップと必要な体制・費用・ツール』の記事も合わせてご覧ください。

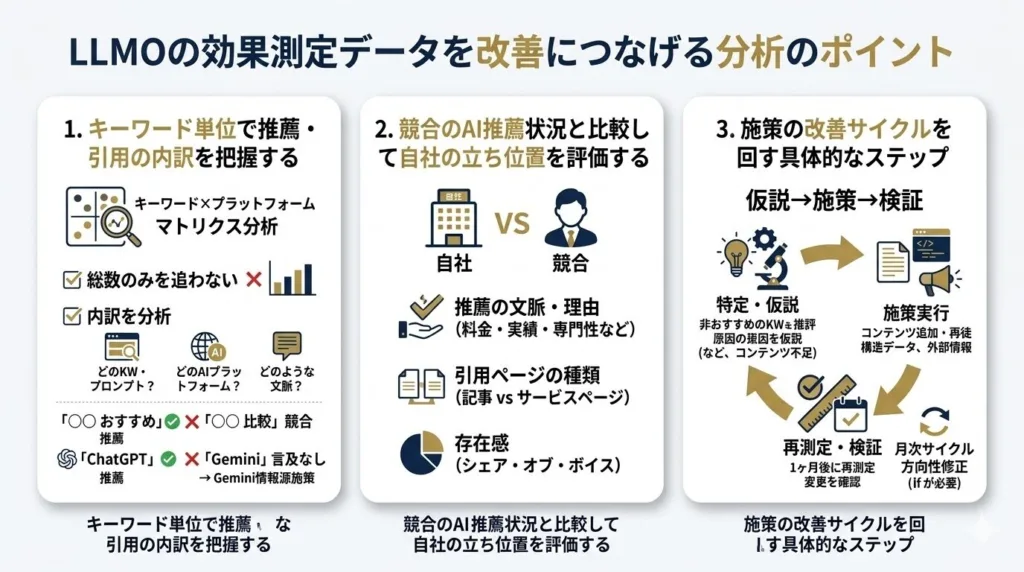

LLMOの効果測定データを改善につなげる分析のポイント

収集した効果測定データを改善施策に活かすためには、適切な分析の視点が欠かせません。ここでは、データを読み解いて次のアクションに結びつけるための3つのポイントを解説します。

キーワード単位で推薦・引用の内訳を把握する

LLMOの効果を分析する際、「合計で何回言及されたか」という総数だけを追いかけるのは避けましょう。重要なのは、どのキーワードやプロンプトで、どのAIプラットフォームにおいて、どのような文脈で推薦・引用されているかという内訳です。たとえば、自社が「○○ おすすめ」では推薦されているが「○○ 比較」では競合だけが言及されている場合、比較検討系コンテンツの強化が改善の方向性になります。また、ChatGPTでは推薦されているがGeminiでは言及されていないという偏りがあれば、Geminiが参照しやすい情報源(AI Overviews経由の引用やWeb上の構造化情報)に対する施策を検討します。このように、キーワード×プラットフォームのマトリクスで分析することで、具体的な打ち手が見えてきます。

競合のAI推薦状況と比較して自社の立ち位置を評価する

自社の数値だけを見ていても、LLMOの成果を正確に判断することはできません。競合他社が同じプロンプトでどのように推薦・引用されているかをあわせて確認することで、自社の相対的な立ち位置が明確になります。チェックすべきポイントは3つです。まず、「競合はどの文脈でおすすめとして挙げられているか」を確認します。推薦の理由(料金、実績、専門性など)が自社とどう異なるかを把握すると、差別化のヒントになります。次に、「自社と競合で引用されているページの種類(記事かサービスページか)はどう違うか」を比べます。競合がサービスページで引用されているなら、自社のサービスページの情報充実が優先施策になるかもしれません。最後に、「特定のプロンプトでどの企業が優先的に言及されているか」を確認し、自社のシェア・オブ・ボイス(AI回答内での存在感の割合)を推定します。

施策の改善サイクルを回す具体的なステップ

分析結果を改善につなげるためには、「仮説→施策→検証」のサイクルを明確に設計することが重要です。具体的なステップとしては、まず分析データから「自社が推薦されていないキーワード」や「文脈が意図と異なる言及」を特定し、改善仮説を立てます。たとえば、「比較検討系プロンプトで言及されないのは、自社サイトに比較・検討に適したコンテンツが不足しているからではないか」という仮説です。

次に、その仮説に基づいてコンテンツの追加・リライト、構造化データの整備、外部メディアでの情報発信などの施策を実行します。実行後は、最低1か月の観測期間を置いてから同一条件で再測定し、言及率や文脈に変化があったかを確認します。変化が見られなければ仮説を修正し、次の施策を検討します。このサイクルを月次で回し続けることが、LLMOの継続的な改善の基盤になります。

LLMOの効果測定シートの記入例

ここでは、手動チェックの結果を記録するための測定シートのサンプルを紹介します。Googleスプレッドシートなどに以下の項目を設定し、定点観測のたびに記入していくことで、推薦状況の変化を時系列で追跡できます。

| 日付 | AI名 | プロンプト | 自社言及有無 | 競合言及有無 | 引用URL有無 | 言及文脈 | メモ |

|---|---|---|---|---|---|---|---|

| 2026/3/3 | ChatGPT | ○○のおすすめ企業は? | あり | A社・B社あり | あり(サービスページ) | 推薦 | 3社中2番目に紹介。料金面で評価 |

| 2026/3/3 | Gemini | ○○のおすすめ企業は? | なし | A社・C社あり | なし | — | 自社は言及なし。A社が最初に推薦 |

| 2026/3/3 | AI Overviews | ○○ おすすめ | あり | B社あり | あり(コラム記事) | 中立紹介 | 引用元は自社ブログのまとめ記事 |

| 2026/3/10 | ChatGPT | ○○のおすすめ企業は? | あり | A社・B社あり | あり(サービスページ) | 推薦 | 前週と同様の結果。安定して推薦 |

| 2026/3/10 | Gemini | ○○のおすすめ企業は? | あり | A社・C社あり | なし | 比較候補 | 先週なし→今週は候補として登場 |

記録のポイントとして、「言及文脈」の列は「推薦」「比較候補」「中立紹介」「否定」「誤認」のいずれかで統一して記入すると、時系列での文脈変化を追いやすくなります。また、「メモ」欄には、回答内での言及順序や特筆すべき表現の変化を簡潔に記録しておくと、後の分析で役立ちます。このシートを毎週同じ条件で更新し、月末にKPIの集計と傾向分析を行うサイクルが、LLMOの効果測定における基本運用です。

LLMOの効果測定に関するよくある質問

LLMOの効果はどれくらいで出ますか?

LLMOの効果が目に見える形で現れるまでには、最低でも1〜3か月程度の期間を見ておく必要があります。生成AIが参照する情報源の更新頻度やインデックスの仕組みはプラットフォームごとに異なり、コンテンツを改善してもすぐに回答に反映されるわけではありません。まずは1か月間の定点観測でベースラインを把握し、3か月ごとに傾向の変化を評価するのが現実的な進め方です。

LLMOの効果測定はSEOと何が違いますか?

SEOでは検索順位やオーガニック流入数といった明確な定量指標が確立されていますが、LLMOには「順位」に相当する標準指標がありません。また、生成AIの回答は毎回変動するため、再現性のある測定には複数回のチェックと条件の固定が必要です。さらに、LLMOでは定量データだけでなく、AIが自社をどのような文脈で言及しているかという定性評価も重要な測定対象になります。

AI流入が少なくても成果が出ていることはありますか?

あります。生成AIで自社が推薦された結果、ユーザーがGoogleで自社名を指名検索するケースは少なくありません。この場合、GA4上の参照元はオーガニック検索やダイレクトとして記録されるため、AI流入としてはカウントされません。指名検索数の増加をあわせてチェックすることで、表面上は見えにくいAIの貢献度を把握できます。

無料ツールだけでも測定できますか?

基本的な測定は無料ツールだけでも可能です。GA4でのAI経由流入の確認、Google Search Consoleでの指名検索数の追跡は無料で行えます。また、ChatGPTやGeminiに直接プロンプトを入力して言及状況を手動で確認する方法もコストはかかりません。ただし、手動チェックには工数がかかるため、測定対象を絞り、スプレッドシートで記録を効率化する工夫が必要です。

AI Overviewsの流入はGA4とSearch Consoleのどちらで見るべきですか?

結論としては、AI Overviewsの流入を「これだけ」で正確に測れるツールは現時点では存在しません。GA4ではAI Overviews経由のクリックが通常のgoogle/organicに含まれるため分離できません。Search Consoleでは、AI Overviews内のリンクのクリック・表示回数は計測されますが、通常の検索結果データと統合されて表示されるため、AI Overviews分だけを切り出すことはできません。両ツールのデータを組み合わせつつ、AhrefsやSemrushのようなSEOツールでAI Overviewsへの引用状況を別途モニタリングするのが現実的なアプローチです。

ChatGPT経由の流入がdirectになることはありますか?

あります。特にChatGPTのモバイルアプリ経由でリンクがクリックされた場合、ブラウザに参照元情報が渡されず、GA4上で(direct)/(none)として計測されるケースが報告されています。そのため、GA4で確認できるAI流入は全体の一部であるという前提で分析を進める必要があります。

LLMOの効果測定は何ヶ月続ければ判断できますか?

最低3か月は続けることを推奨します。生成AIの回答にはばらつきがあるため、1〜2か月のデータだけでは傾向が安定しません。3か月分のデータが蓄積されると、言及率の推移や指名検索数の増減に一定のトレンドが見えてきます。そこから改善施策の効果を判断し、次のアクションを決めるサイクルに入ります。

まとめ:LLMOの効果測定は「成功状態の定義」と「定点観測」から始めよう

LLMOの効果測定は、SEOのように確立された指標体系がないからこそ、「自社にとっての成功とは何か」を最初に定義することが重要です。その上で、ブランド言及率・AI経由流入数・指名検索数の3つからまず始め、施策の成熟度に応じて引用キーワード数や言及文脈の正確性を追加していきましょう。計測にはGA4・Search Console・Ahrefs Brand Radarなどを使いますが、それぞれ測れること・測れないことが異なるため、ツールの特性を理解した上で組み合わせることが大切です。まずはChatGPT・Gemini・AI Overviewsの3面で定点観測し、流入だけでなく言及内容の質も見るところから始めましょう。LLMOの効果測定でお悩みの方は、アドカルまでお気軽にご相談ください。

【SEO・LLMO対策でお困りではないですか?】

株式会社アドカルはSEO対策・LLMO対策に強みを持った企業です。

貴社のパートナーとして、少数精鋭で担当させていただくので、

「LLMO対策について詳しく知りたい」

「現状のSEO対策で成果が出ていない」

「LLMO対策でAI検索からの集客を強化したい」

とお悩みの方は、ぜひ弊社にご相談ください。

貴社のご相談内容に合わせて、最適なご提案をさせていただきます。

サービスの詳細は下記からご確認ください。無料相談も可能です。